2024/08/16

防災・危機管理ニュース

人工知能(AI)の安全性を評価する際の基準を検討する政府の専門機関「AIセーフティ・インスティテュート(AISI)」の村上明子所長が15日までにインタビューに応じ、安全なAIを使っているかどうかを事業者が確認するためのチェックポイントを整理していることを明らかにした。月内をめどに公表する。

生成AIが普及する中、偽情報の生成と拡散、知的財産権侵害などへの懸念から国際的にAIの安全性に対する関心が高まっている。政府は「海外(の研究)機関と連携し、安全性の評価手法の研究や規格作成などを行う機関が必要」(岸田文雄首相)として、AISIを2月に設置した。

村上氏は「(事業者の使用している)AIが安全か危険かをどのようにすれば評価できるか、という観点を整理している」と述べた。基準の策定に先立ち、生成AIが個人情報を読み込んだデータを参照していないかなどを確認するための観点をまとめ、安全性評価の参考にしてもらうのが目的。AIのセキュリティー上のリスクを事前に特定するテストの手順書公開も検討する。

AI規制を巡っては、欧州連合(EU)が5月に関連法を成立させた。日本でも法規制の必要性に関する議論が始まった。村上氏は、規制の議論では「人命や人権に関わる部分を法制度で守っていく検討を怠ってはいけない」と指摘した。

AISIは現在、関係省庁や民間企業からの出向者ら24人の体制。村上氏は、専門人材の確保を進め、組織を2倍程度に拡大していきたい考えも示した。基準策定に向け、産業技術総合研究所や理化学研究所などとの協力も進めていく方針だ。

〔写真説明〕インタビューに応じるAIセーフティ・インスティテュート(AISI)の村上明子所長=7月26日、東京都新宿区

〔写真説明〕インタビューに応じるAIセーフティ・インスティテュート(AISI)の村上明子所長=7月26日、東京都新宿区

(ニュース提供元:時事通信社)

- keyword

- AI安全性

防災・危機管理ニュースの他の記事

おすすめ記事

-

リスク対策.com編集長が斬る!今週のニュース解説

毎週火曜日(平日のみ)朝9時~、リスク対策.com編集長 中澤幸介と兵庫県立大学教授 木村玲欧氏(心理学・危機管理学)が今週注目のニュースを短く、わかりやすく解説します。

2025/04/01

-

-

-

-

-

全社員が「リスクオーナー」リーダーに実践教育

エイブルホールディングス(東京都港区、平田竜史代表取締役社長)は、組織的なリスクマネジメント文化を育むために、土台となる組織風土の構築を進める。全役職員をリスクオーナーに位置づけてリスクマネジメントの自覚を高め、多彩な研修で役職に合致したレベルアップを目指す。

2025/03/18

-

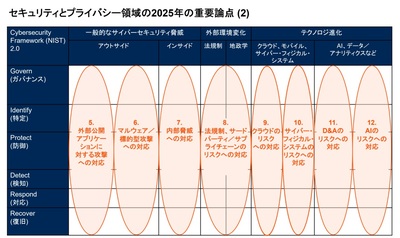

ソリューションを提示しても経営には響かない

企業を取り巻くデジタルリスクはますます多様化。サイバー攻撃や内部からの情報漏えいのような従来型リスクが進展の様相を見せる一方で、生成 AI のような最新テクノロジーの登場や、国際政治の再編による世界的なパワーバランスの変動への対応が求められている。2025 年のデジタルリスク管理における重要ポイントはどこか。ガートナージャパンでセキュリティーとプライバシー領域の調査、分析を担当する礒田優一氏に聞いた。

2025/03/17

-

-

-

なぜ下請法の勧告が急増しているのか?公取委が注視する金型の無料保管と下請代金の減額

2024年度は下請法の勧告件数が17件と、直近10年で最多を昨年に続き更新している。急増しているのが金型の保管に関する勧告だ。大手ポンプメーカーの荏原製作所、自動車メーカーのトヨタや日産の子会社などへの勧告が相次いだ。また、家電量販店のビックカメラは支払代金の不当な減額で、出版ではKADOKAWAが買いたたきで勧告を受けた。なぜ、下請法による勧告が増えているのか。独占禁止法と下請法に詳しい日比谷総合法律事務所の多田敏明弁護士に聞いた。

2025/03/14

![2022年下半期リスクマネジメント・BCP事例集[永久保存版]](https://risk.ismcdn.jp/mwimgs/8/2/160wm/img_8265ba4dd7d348cb1445778f13da5c6a149038.png)

※スパム投稿防止のためコメントは編集部の承認制となっておりますが、いただいたコメントは原則、すべて掲載いたします。

※個人情報は入力しないようご注意ください。

» パスワードをお忘れの方